(本文由黄晚编译,原文:Do Self-Driving Cars Dream Of Safe Streets? )

今年早些时候,在美国得克萨斯州奥斯汀举行的 SXSW 大会上,福特董事长比尔·福特说出了许多汽车界从业人士都在思考,或者更确切的说,其实是在担忧的一件事——即将到来的无人驾驶。

随着各大汽车厂商和硅谷玩家们对全自动驾驶(即 L5 自动驾驶,没有方向盘和踏板)持续不断的大手笔投入,这一领域正吸引越来越多人关注的目光,并成为人们争相报道的对象。

比尔·福特说,无人车的具体设计制造相对来说较为简单,因为技术正在飞速进步,困难的是如何让无人车去做生死抉择。「如果一辆无人车在事故快要发生时必须选择去撞谁,那么它是应该保住乘客的性命还是避免撞到行人?人类司机没有时间考虑这样的问题,我们仅仅本能的做出反应。但是,无人车有能力对结果做出选择。如果它最终决定牺牲你来挽救其他人的生命,那么你还会坐这辆车吗?

比尔·福特公开谈论这一问题对正发展得如火如荼的无人驾驶来说只是小小地提了个醒,但它却在美国购车者中引发了一连串的思考。今年早些时候,美国汽车协会(AAA)曾做过一项调查,调查结果显示,四分之三的司机害怕乘坐无人车,54%的受访者表示路上有无人车会让他们缺乏安全感。而且,在比尔·福特开启这个话题之后,有人就得出结论:「如果我们需要告诉一辆无人车它是应该杀死一位修女还是一个童子军,那么就不会有无人车了。」这正是英特尔高级副总裁及 Mobileye 联合创始人 Amnon Shashua 的观点(今年 3 月份,英特尔以 153 亿美元的价格收购了 Mobileye)。

Shashua 相信,要想解决这个问题,必须从实际出发来考虑,而不是把它当作一个复杂无解的哲学或伦理学难题。简单来说,他认为,无人车能否被消费者广泛认可并接受的关键在于:大众对无人车的交通事故率抱有一个什么样的期待。

就目前而言,这个问题的答案可能为 0。也就是说,大家希望无人车不要出事儿。无论是去年佛罗里达州那起致命的特斯拉事故,还是最近拉斯维加斯无人驾驶小巴被撞事件,舆论的反应都极为强烈,不仅给予其头版头条的「殊荣」,还大有揪住不放之势。相反,对传统交通工具几乎每日如例行公事般重复的连环相撞以及间或的重大伤亡,甚至连地方报纸都有些不屑一顾。

与此同时,世界各地的监管者们正迫不及待地想让无人车尽快上路,以最小化由交通事故引起的无情灾难,但这也进一步强化了人们对无人车安全问题过度的关注和警觉。去年,美国国家公路交通安全管理局(NHTSA)表示,他们对将无人车作为「显著减少由人为因素导致的交通事故」的手段持肯定态度。

在这样的背景下,Shashua 和 Mobileye 的程序员们想出了一个能够消除人们对无人车的恐惧的创造性的解决办法。他们在一定程度上以 NHTSA600 万交通事故的数据为基础,制定出了一套覆盖所有交通事故排列可能的近 40 个方案,然后再把人类司机针对交通规则和路况所能作出的完美判断编成算法公式。Shashua 称,以这些规则为基础,为无人车在每一可能情况下的决定编程,汽车厂商们就可以向消费者保证,即使发生事故,无人车也不会是需要负责的那一方。

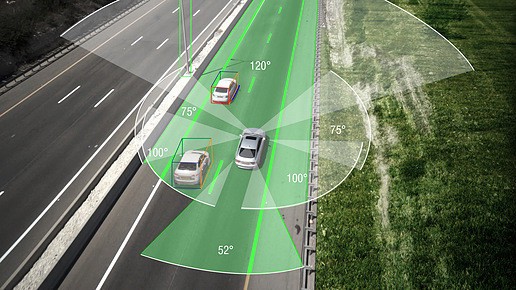

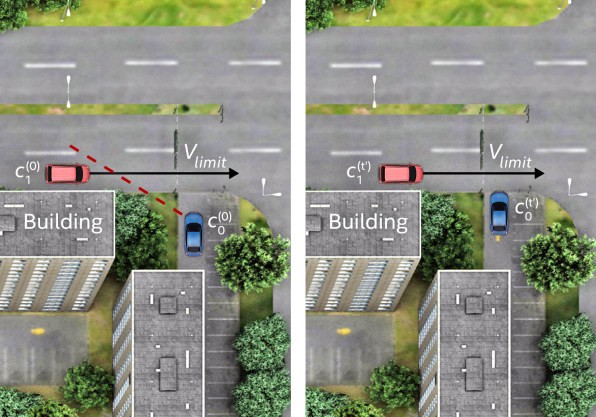

Mobileye 安全系统的核心奉行这样一个概念——谨慎控制,这个原则将为无人车提供可使它保持在安全领域内的可用选择。例如,下面这幅图中就展示了一幕常见的场景。

蓝车正试图驶出停车位,但却被旁边的建筑物挡住了视线,不知道道路上是否有车正向它这一边驶来。如果是一位小心谨慎的司机,他会慢慢挪动,逐渐扩大视野范围,直到他觉得可以开出去了。但是,实际情况却是,他不可能获得完全的视野,最后一刻作出决定也是仅凭直觉。即使他已经做得很好了,他还是有可能因为自己的行为为即将到来的交通事故负责。如果他是一位马虎的司机,还在心不在焉的弄导航或打电话,发生事故的可能就更大了。

相反,处于「谨慎控制」中的无人车将以限速为基础计算红车最高的合理车速,以此决定在给红车刹车机会并逐渐获得完全视野的前提下它可以开出多远。如果红车超速了,那么发生车祸就是它的责任了。而如果红车也是一辆无人车,它会开得更加小心翼翼,并在估计到可能会有在它视野之外的汽车从停车位出来后向马路中央靠拢。

谨慎控制似乎让比尔·福特担心的那个「无人车必须做出选择」的棘手难题变得毫无意义,主要原因在于,「在即将发生的车祸中谁生谁死」这一伦理上的两难处境被一个严格、冷静的规则所取代:如果非无人车因自身失误有与无人车发生碰撞的可能,无人车将尽量避免碰撞发生,但不会以主动引发另一事故为代价减轻当前伤害。

也就是说,如果没有其他安全方案可供选择,无人车将接受碰撞的事实,即使车内乘客会有生命危险。「换个角度来看问题,我们就会陷入滑坡理论。」Shashua 说。「或许一辆车看起来后座好像没有人——所以它可以用后部迎接无人车的碰撞——实际上却坐着婴儿。也就是说,存在着不可见因素。且事后看来,无人车的所作所为其实造成了更严重的后果。」

Mobileye 相信,如果所有汽车厂商都采用其以成千上万的事故模拟为基础的开源算法公式,美国每年的交通事故死亡率将下降三个数量级,即从每一百万小时的驾驶时间发生一起交通死亡事故下降到每 10 亿小时的驾驶时间发生一起交通死亡事故。当然,这得假设所有汽车都是无人车,而事故原因将是设备故障或恶劣的驾驶环境。

有些专家对 Mobileye 的安全宣言表示反对。如杜克大学人类和自主实验室的主任 Missy Cummings 就告诉 EETimes,Mobileye 可能低估了会影响无人车的潜在软件错误的数量。她以 2016 年的 Stout Risius Ross 汽车保修和召回报告为证指出,自 2012 年以来,在汽车召回案例中软件问题所占的比重越来越大。这份调查还发现,2005 年至 2012 年间,共有 32 次召回是因软件问题而起,涉及车辆 360 万辆。从 2012 年底到 2015 年 6 月期间,这一数字几乎翻了一番。但是,EETimes 采访的所有学者和工程师都对 Mobileye 为无人车安全所做的努力表示赞赏。

目前为止,Mobileye 的安全算法在汽车界只能算是曲高和寡,因为大家都在奋力争夺无人驾驶领域的话语权。无论是 Google、Uber、Lyft 还是众多的初创公司以及各大汽车厂商,大家都认为完全自动驾驶将在下一个十年内到来。没有人想冒着失去市场领导权的风险去过早地接触规则,并最终成为竞争中的失败者。「Mobileye 认为应该制定安全标准,这点毫无疑问并没错,但是在当前局势下,汽车厂商们想的只有一件事——疯狂发展技术。」C3 Group 董事长兼联合创始人 Doug Newcomb 说。

对于汽车厂商们的做法,Shashua 将之归类为行业自杀行为。没有统一的安全标准,汽车厂商们只会各行其是:以成千上万次的多余模拟对无人车进行过度设计,超出需要地堆积传感器和计算能力。对外,他们一致宣称汽车有充分的安全保障,但却没人能绝对保证这些汽车不会引发交通事故。其结果就是,发生车祸后这些汽车厂商可能会面临极高的法律风险,而且这些因为装备了各种昂贵部件而造假不菲的无人车,将超出普通消费者的能力范围。与此同时,有些汽车厂商可能会以安全考虑为代价换取低廉的售价,但这会给消费者选择安全的无人车带来混乱,并进一步加深他们的这一信念:无人车很危险。

迫于无人车开发者们要求更多发挥空间的压力,美国政府似乎已决意采取放任自由的态度。目前,有一项法案已被众议院通过并提交给了参议院,这一法案将以综合立法的权力替代之前东拼西凑的州立法规,这些州立法规只允许无人车在特定道路上进行有限制的测试(有些州至今为止都不允许无人车上路)。一旦最终通过,NHTSA 将有权规定无人车的设计、结构、性能,而各州则只负责车辆登记和许可。最重要的可能是,这一法案通过后,NHTSA 就可以批准无人车厂商每年在美国道路上投放 10 万辆暂不符合联邦机动车安全标准的无人车(三年内逐步实施)。

面对这一有待通过的「随心所欲」的法案,Mobileye 想要说服汽车厂商们齐心协力处理安全和事故责任问题将是难上加难。而我们也将比预期更早发现,在为无人车编程的过程中,扮演上帝角色的开发者们,是否真如他们自己所想的那样能让无人车万无一失?

原创声明: 本文为 GeekCar 原创作品,欢迎转载。转载时请在文章开头注明作者和「来源自 GeekCar」,并附上原文链接,不得修改原文内容,谢谢合作!

欢迎关注 GeekCar 微信公众号: GeekCar 极客汽车(微信号:GeekCar)&极市(微信号:geeket)。