在每年美国 CES 正式开始的前一天晚上,都会有一位科技领域的大佬在拉斯维加斯最高端的酒店之一「威尼斯人」做一场演讲,作为整个展会的开端。今年正值 CES 50 周年,这个「非官方开场」就显得更加有意义。而这次站在威尼斯人酒店舞台上的人,正是 NVIDIA(以下称为英伟达)的 CEO 黄仁勋(以下称为老黄)。

2016 年可以说是英伟达大爆发的一年。GPU 驱动下的人工智能与深度学习技术让整个科技行业为之疯狂,这不只让英伟达的股价和利润在 2016 年各种翻倍,更让他们有能力进一步扩展人工智能在汽车行业,尤其是自动驾驶领域内的应用。

在这次演讲当中,老黄用了整整一半的时间来公布英伟达在自动驾驶领域内的最新解决方案与合作进展。这足以看出他有多么重视汽车业务。下面我们就来分析一下老黄公布的全部与汽车相关的信息。

人工智能驱动下的自动驾驶解决方案

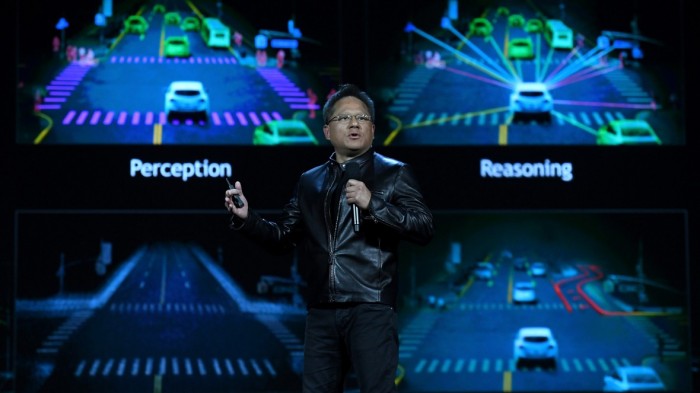

·在老黄看来,通过深度学习的方式让人工智能不断地优化自己的驾驶行为,是目前最有效的自动驾驶解决方案。这个流程就好像是我们人类去学习开车一样,只不过如何让机器能够像人类大脑一样学习才是这其中的难点,而这也是英伟达目前正在用自己的平台所努力解决的问题。其解决方案主要包括两点:

1. 人工智能车载超级电脑(AI CAR SUPERCOMPUTER)

在去年的 CES 上,老黄就已经发布了他们的车载超级电脑 Drive PX2,今年他又对这套芯片做了进一步的迭代优化。这套称为 XAVIER 的超级电脑整合了多种芯片,其中包含了 8 核心的 ARM64 CPU,以及具有 512 个核心的 Volta 架构 GPU。Volta 是英伟达下一代的 GPU 核心架构,甚至还没有应用在 PC 端的显卡产品上,这套架构拥有 30 Tops DL ,功耗仅为 30W,且整套系统符合车规级安全标准 ASIL D 级。

将自己最新的 GPU 架构率先应用在自动驾驶平台上,老黄确实非常拼。其实我在之前的文章中就解释过,由于 GPU 的架构原因,其在深度学习方面的应用本就十分拥有优势。而老黄这次的演讲中进一步解释了车载超级电脑在自动驾驶环境中所提供的功能:接收车载传感器所传回的数据信息并加以分析,之后输出能够控制汽车各部分元器件控制单元(例如转向、加速等)的 CAN 总线信息,简单讲就是将车辆感知到的信息加以分析,然后再输出控制车辆行驶的指令,可以说这套电脑就是用来替代人脑在驾驶行为当中的判断与决策能力的。

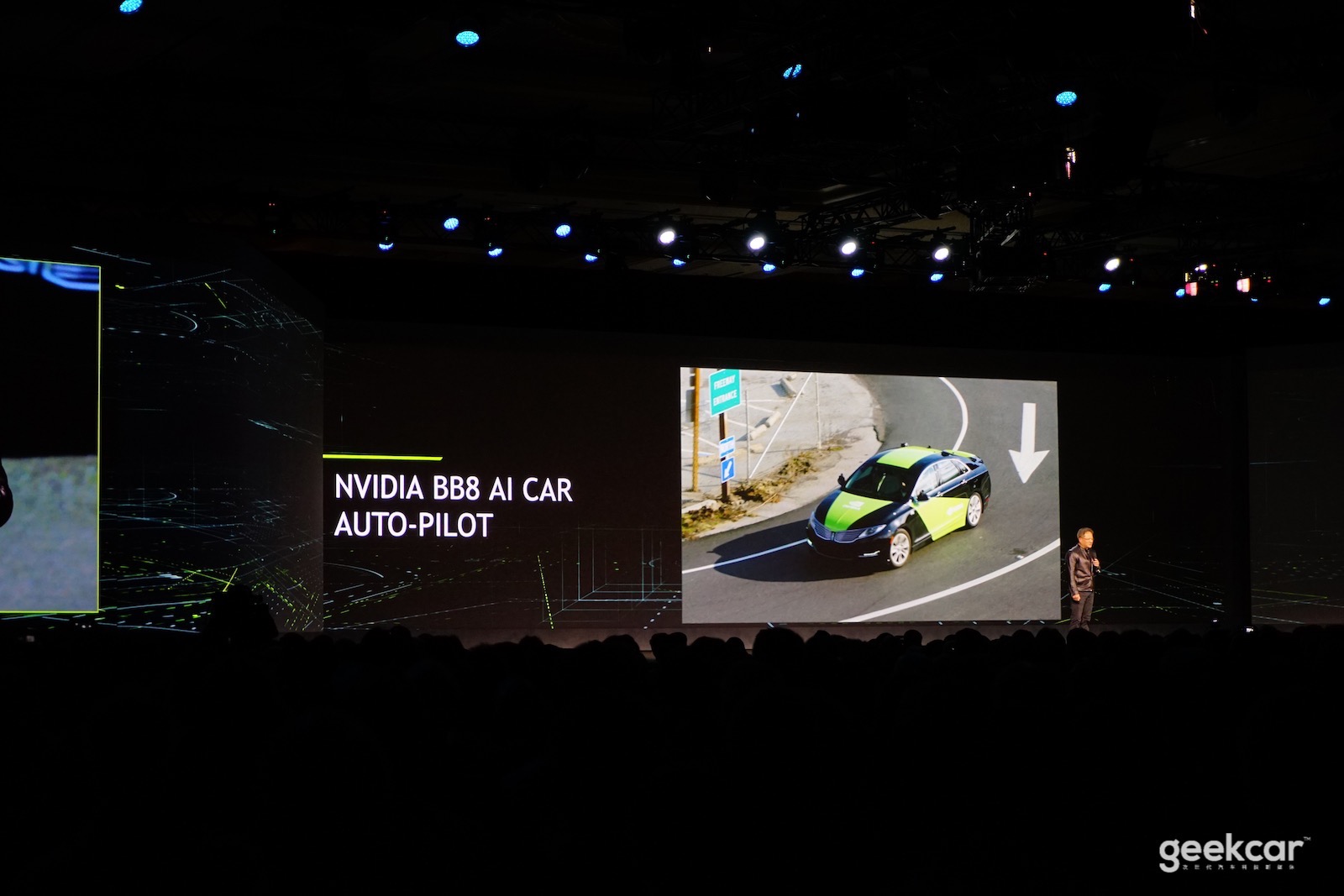

2. 自动驾驶测试车 BB8

深度学习光有硬件是不够的,还需要有足够的学习「素材」。为了让自己的深度学习平台能够积累更多的行驶数据,英伟达自己打造了一台自动驾驶测试车辆 BB8,并获得了加州自动驾驶车辆的测试牌照。BB8 搭载了 Drive PX2 电脑,并已经开始在道路上进行行驶测试。后天 GeekCar 将有机会能够在 CES 现场试乘 BB8,届时将会为大家带来具体介绍。

AI CO-PILOT 系统

老黄认为具有云端连接的人工智能汽车应该已经具备能力在世界上的很多地方实现自动驾驶。但是,目前总会有一些路况或条件中,人工智能是无法完全依靠自己来驾驶的,这时就需要驾驶者的介入。由于人工智能事先已经了解到整条行驶路线的规划,它就能够根据路线中不同位置的路况来决定是否需要人类驾驶者介入。因此为了能够更好的实现自动驾驶和人工驾驶之间的切换,英伟达研制了一套人工智能的自动巡航辅助系统(AI CO-PILOT)。

需要注意的是,这套系统被称为 CO-PILOT,我将它翻译成自动巡航辅助系统,而不是自动驾驶辅助系统。原因是这套系统的应用场景更多的是在 SAE 所定义的 LEVEL 2 或 LEVEL 3 级别的半自动驾驶环境当中。在这种级别当中,驾驶者需要随时准备好接管车辆的驾驶控制权,但是很多事实告诉我们,人类驾驶者很难能够长时间维持足够的注意力,这往往会导致事故的发生。AI CO-PILOT 的诞生正是为了解决这样的问题。

这套系统主要包含五个功能:

1. 语音预警提示:在人工驾驶和环境中,车身周围的四个摄像头实时监控周围的路况,并通过自然语音的预警方式向驾驶者提示潜在危险。

这第一个功能与我们常见的 ADAS 类似,但是进一步优化了预警方式。接下去的四个功能,则是让车载人工智能能够更好的了解驾驶者的状态。

2. 人脸识别(Face Recognition):AI 可以通过摄像头识别驾驶者的身份,即使是驾驶者的发型或者是装扮发生了变化。其精度已经可以达到人类的级别。

3. 头部跟随(Head Tracking):AI 能够通过摄像头识别驾驶者头部所朝的方向。

4. 目光跟随(Gaze Tracking):AI 能够通过深度学习网络对人眼进一步识别,来判断出驾驶者的目光所关注的点。

5. 唇语识别(Lips Reading):这个功能来源于牛津大学的一项唇语研究,他们的成果能够让人工智能对唇语的识别精度达到 95%,比人类的识别精度高出一倍。

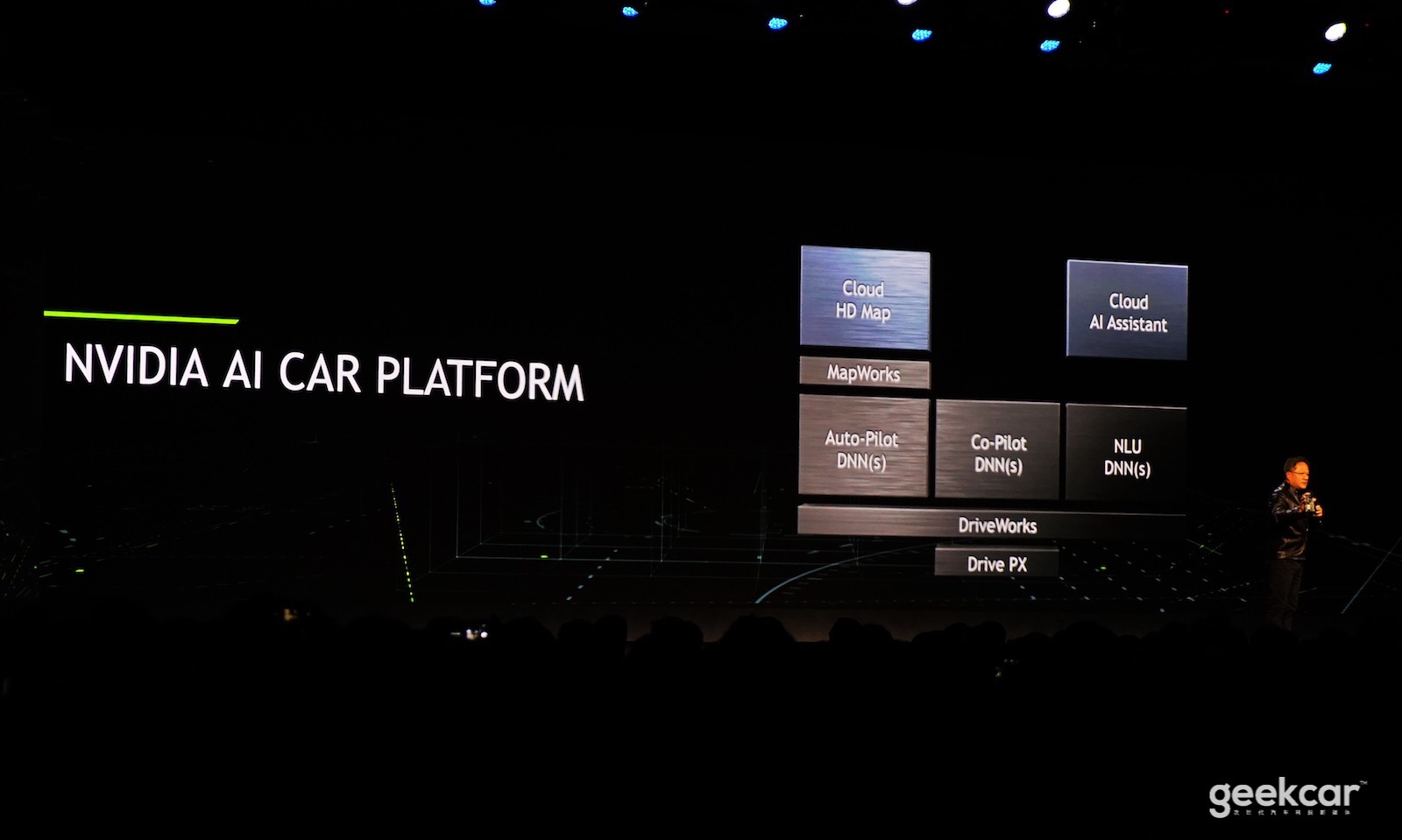

上述的几个功能,旨在让车载系统能够持续观察驾驶者的行为,并在适当的时机与驾驶者交互,保证其维持足够的注意力。而正如我们之前文章中所分析的,整套系统的基础仍然是英伟达的人工智能汽车平台(AI CAR PLATFORM)。

基于 AI CAR PLATFORM 的合作伙伴

除了前面提到的超级电脑和 AI CO-PILOT,英伟达的人工智能汽车平台还包含其它部分,比如高精度地图。为了搭建出这套完善的平台,英伟达选择了与行业内的巨头们合作。

在高精度地图方面,英伟达针对不同国家地区的具体情况选择了不同的合作伙伴:

1. 百度:提供中国地区的高精度地图。

2. TomTom:提供欧洲地区的高精度地图,及 RoadDNA 技术。

3. Zenrin:提供日本地区的高精度地图。

4. Here:将英伟达的算法与技术整合到 Here 的云端地图数据中心。

除去地图商之外,英伟达还和两家 Tier 1:博世和 ZF 达成了合作,他们能够帮助英伟达将其车载超级电脑进行车规级量产,并将英伟达的平台整合到给车厂的整体方案当中。

博世和 ZF 是全球第一大及第五大汽车供应商,大家如果常读我们的内容一定知道这两家 Tier 1 的实力。老黄也在后来的专访中直言,与 Tier 1 的合作对英伟达来说至关重要,因为他们的整合,优化与制造能力直接决定了英伟达的技术在量产车产品当中的表现,以及其平台能否最终在车厂的产品上落地。

最后,建造人工智能车,没有整车厂的介入是不可能的。所以老黄在演讲的最后,宣布了与奥迪的合作。双方将联手研发未来的人工智能汽车,并计划在 2020 年能够正式上路。其实早在 10 年之前,奥迪就已经开始在车载数字座舱以及车内视觉交互领域内合作,这次的发布可以说是更进了一步。

现在在 CES 的会场外,就有一台搭载英伟达车载超级电脑的奥迪 Q7 在进行行驶测试。GeekCar 后续也将会对这台车做具体的介绍。

在演讲的最后部分,老黄说到:「希望我们的孩子在未来可以再也不用开车了」,这已经是行业内的共同愿景,在人工智能和深度学习的驱动下,我们还需要多长时间才能够实现这个愿望?这个问题我相信老黄自己也无法解答,但是可以肯定的是这位被科技爱好者称为 「AI 教父」 的华裔企业家以及他的英伟达,一定会在自动驾驶的发展过程中占据一个重要的位置。

原创声明: 本文为 GeekCar 原创作品,欢迎转载。转载时请在文章开头注明作者和「来源自 GeekCar」,并附上原文链接,不得修改原文内容,谢谢合作!

欢迎关注 GeekCar 微信公众号: GeekCar 极客汽车(微信号:GeekCar)&极市(微信号:geeket)。

2 responses to “CES 2017 | 详解英伟达 CEO 黄仁勋演讲:「AI 教父」的自动驾驶布局”